百度端到端语音语言大模型破局出圈,对话超逼真、成本最高降90%,1秒极速响应

作者 | 程茜

编辑 | 漠影

语音交互又被玩出新花样?!

智东西4月2日报道,本周一,百度发布业界首个基于全新互相关注意力(Cross-Attention)的端到端语音语言大模型,已首发上线文小言,可免费体验。

用几个关键词概括新升级的文小言就是:语音交互超逼真、超低时延、超低成本。

超逼真指的是,搭载语音语言大模型的文小言,既能听得懂重庆、广西、河南、广东、山东等特色方言,还能实现情感饱满对话;超低时延是其对话中可将用户等待时长从行业常见的3-5秒降低至1秒左右,几乎与真人对话无异;超低成本指在电话语音频道的语音问答场景中,调用成本较行业均值下降约50%-90%。

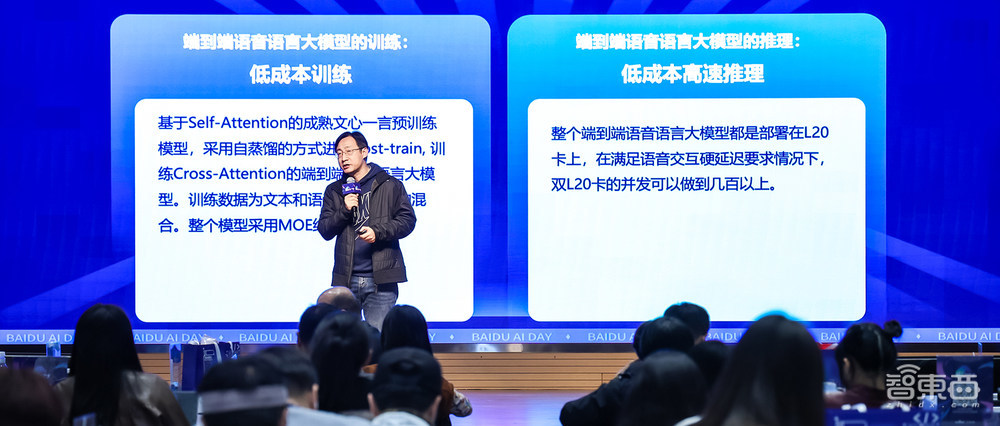

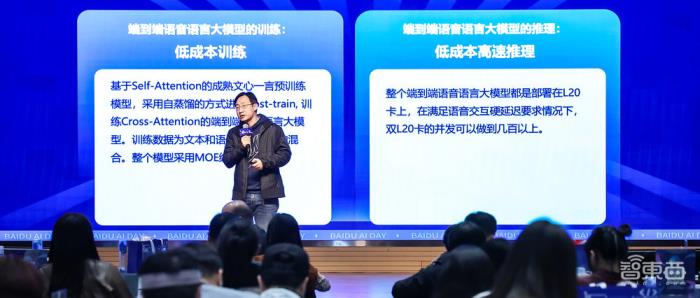

百度语音首席架构师贾磊透露,该模型可以部署到L20卡上,在满足语音交互延迟要求的情况下,双L20卡的并发可以做到几百以上。目前,语音语言大模型的训练流程便捷,基本上基于文心大模型几百片卡优化一周就可以实现,且本身的优化工作也并不复杂。

相比于大模型在语音交互场景的应用,这一语音语言大模型的独特之处是什么?又是如何做到最高降低达到90%的调用成本?其背后的创新点该如何解读?智东西与百度语音首席架构师贾磊进行了深入交流,试图找到这些问题的答案。

一、真人对话体验,升级版文小言语音交互更丝滑

大模型在语音交互场景的发展,正朝着更自然、低延迟、高拟真的语音交互体验演进。而这一更为拟人化的交互体验,我们在新升级的文小言上窥到了雏形,搭载了端到端语音语言大模型的文小言,已经化身情感陪伴、全能助手。

首先,文小言已经集成了包含天气查询、日历查询、单位换算、股票股价等信息查询的38个垂类助手,可以看出这些特殊场景下,语音交互的效率要远高于文本交互。

其次,文小言对于时效性和非时效性问题均能应对,百科查询、时政知识类时效性问答内容,文小言可以进行实时检索,并做到精准的指令跟随,降低幻觉;常识问答等非时效性问题也不在话下。

最后,也是语音交互与文本最大的区别所在,文小言可以与用户进行情感自然充沛的交流,并能做到快速响应反馈,实现逼真拟人的交互效果。

话不多说,来看看文小言的实际效果。

语音识别的一大难点莫过于方言识别。方言的发音特点丰富多样,同一方言在不同地区可能存在发音差异,甚至同一个字在不同语境下发音也有所不同。这使得语音识别系统难以准确捕捉和解析所有的发音变体,增加了识别的难度。当下的文小言,已经可以应对重庆、广西、河南、广东、山东各地特色方言,其不仅听得懂,还能使用对应的方言进行回复。

- 免责声明

- 本文所包含的观点仅代表作者个人看法,不代表新火种的观点。在新火种上获取的所有信息均不应被视为投资建议。新火种对本文可能提及或链接的任何项目不表示认可。 交易和投资涉及高风险,读者在采取与本文内容相关的任何行动之前,请务必进行充分的尽职调查。最终的决策应该基于您自己的独立判断。新火种不对因依赖本文观点而产生的任何金钱损失负任何责任。

新火种

2025-05-27

新火种

2025-05-27